机器学习大行于世 – 酌情善用

机器学习 (ML) 作为人工智能 (AI) 的一个子集,在医疗诊断、图像处理、分类、预测、回归测试等应用中已得到有效使用。使用 ML 时,以下两方面往往存在风险:使用安全性和结果有效性。

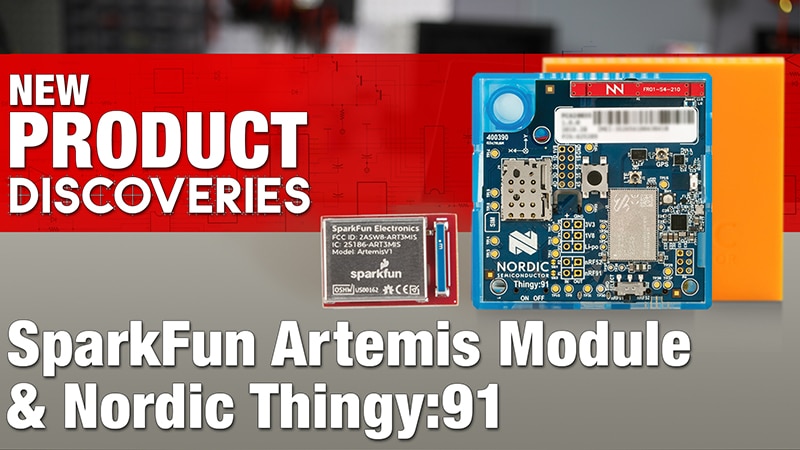

图 1:工业物联网 (IIoT) 中具有许多互连器件,借助于集成机器学习,可以提高系统的管理效率。(图片来源:SlideShare.net)

图 1:工业物联网 (IIoT) 中具有许多互连器件,借助于集成机器学习,可以提高系统的管理效率。(图片来源:SlideShare.net)

如今,人工智能安全攻击已算不上新奇,却日趋复杂化。攻击者常常利用的攻击面,主要是指未经授权的用户悄悄输入或提取数据的点位。风险漏洞往往涉及以下三个方面:输入数据、算法设计和输出决策。

机器学习的最佳实现方法是访问大量数据,而藉此学习达到的水平是人类难以企及的。攻击包括在训练模型中创建“后门”和插入恶意负载或触发器。对于这部分的人工智能,算法极为复杂且不可预测,不受标准和法规的约束,并且基于专有数据,因而愈加难以检测篡改。

除了安全性之外,还有一方面存在风险。由于机器学习模型是由人类所创建,模型中难免存在偏差会对其产生影响。数据偏差相当危险,需要谨慎管理。偏差管理是机器学习风险管理的一个重要方面。

此外,数据不足以及缺少良好或适当数据时,也存在风险。缺少足够的可变数据,导致无法通过数据点来确定最佳输入以获得最佳输出,可能造成比较严重的问题。在数据类型、时间范围及其他可变参数方面,应当使构成机器学习模型的数据尽可能地多样化。

最后,输出解释亦存在风险,因为可能出现输出误解释。模型虽可提供评估和指导,但是为了使解释更有价值,就必须仔细考虑如何构建模型,提出哪些假设以及输出代表的含义。

出现问题的案例有很多,例如:

- 2016 年英国脱欧公投时,由于算法问题,两分钟内英镑贬值了 6%。

- 美国刑事司法系统使用的累犯率预测算法中,存在种族偏见。

- 通过功能性磁共振成像 (fMRI) 发现统计假设错误和漏洞后,许多大脑研究结果都令人怀疑。

- 2017 年比特币价格急速飙升时,黑客可免费使用 Google Cloud 实例进行挖矿。Google Cloud 实例使用 Google Cloud 异常检测系统,因此可向客户发出危害警告。

机器学习系统正努力解决这些难题。尽管在安全性和准确性方面可能受到负面影响,但随着系统所用技术的进步以及相关应用成功案例的增加,这一局面也将逐渐改变。

机器学习的最新进展

STMicroelectronics 最近宣布,其合作伙伴 Cartesiam 使用 STM32G4 实现了首个机器学习应用。Cartesiam 是该公司机器学习 ST 合作伙伴计划的成员。借助 ST 推出的 STM32Cube.AI,开发人员可通过收集数据轻松训练神经网络,继而在 PC 的神经网络训练框架中进行处理,从而识别步行、跑步或游泳等特定活动。然后将输出转换为代码,使 STM32 MCU 能够识别活动。

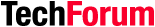

图 2:上图为 STMicroelectronics 的 SensorTile 评估板。(图片来源:STMicroelectronics)

图 2:上图为 STMicroelectronics 的 SensorTile 评估板。(图片来源:STMicroelectronics)

Cartesiam 的 NanoEdge AI 在微控制器上运行学习阶段。由于工程师无法顺利为特定情况创建预先训练的模型,却仍希望使用机器学习来实现智能解决方案,于是就采取这一方法。在 MCU 上运行训练阶段,学习设备在预期环境中的正常行为,然后在同一 MCU 上运行推断以检测并报告行为异常。

NanoEdge AI 针对 STM32 MCU 进行了优化,因此开发人员可将本地的人工智能训练和分析功能轻松集成到 C 代码中。演示说明时,Cartesiam 展示了其机器学习库如何使用 STM 的 SensorTile 模块,即 SensorTile 评估板(图 2),通过振动分析来学习 BLDC 电机的行为,然后借助嵌入式 STM32L4 MCU 来检测并报告行为异常。

STMicroelectronics 的 LSM6DSOX iNEMO 等高级传感器中,也应用了机器学习内核。由于结合了有限状态机 (FSM) 和高级数字功能,该内核可实现从超低功耗状态到高性能状态的转换,并为电池供电的物联网、游戏、可穿戴设备和消费类电子产品提供高精度人工智能功能。该器件支持典型操作系统要求,提供真实、虚拟和批处理传感器,具有 9 KB 的 RAM,可用于动态数据批处理。

无论形式如何,人工智能和机器学习的发展一直令人赞叹不已,但是只有推出新应用、确保输出有效并维护系统安全性,才能不断推动技术的进步。

Have questions or comments? Continue the conversation on TechForum, Digi-Key's online community and technical resource.

Visit TechForum